Questões de Concurso

Para analista de sistemas

Foram encontradas 15.593 questões

Resolva questões gratuitamente!

Junte-se a mais de 4 milhões de concurseiros!

Leia a tira, para responder a questão.

(André Dahmer. Malvados. Disponível em: https://www.roendolivros.com.br.

Acesso em: 04.03.22)

• O exemplo mais antigo de que se tem notícia... • “Estamos entrando em uma era em que nossos inimigos podem fazer com que qualquer um pareça dizer qualquer coisa”.

Duzentos e cinquenta anos depois da invenção de Kempelen, a tecnologia de reprodução da voz humana avançou tanto que, agora, é quase impossível para um leigo diferenciar um discurso real, feito por uma pessoa de carne, osso e cordas vocais, de outro criado em computador.

O trecho – Duzentos e cinquenta anos depois da invenção de Kempelen... – está reescrito de acordo com a norma-padrão de concordância em:

Duzentos e cinquenta anos depois da invenção de Kempelen, a tecnologia de reprodução da voz humana avançou tanto que, agora, é quase impossível para um leigo diferenciar um discurso real, feito por uma pessoa de carne, osso e cordas vocais, de outro criado em computador.

A relação de sentido expressa pelo trecho em destaque, em relação ao trecho precedente, é de

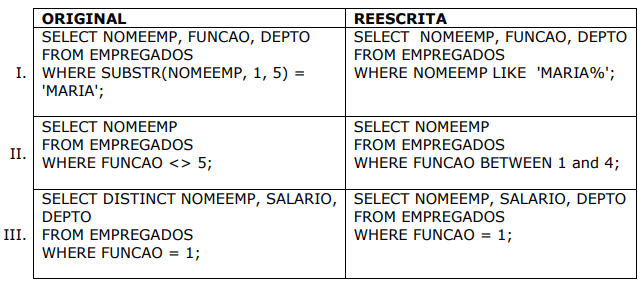

Considere a tabela EMPREGADOS definida abaixo em SQL.

Create table EMPREGADOS

(CODEMP INT PRIMARY KEY,

NOMEEMP VARCHAR(300) NOT NULL UNIQUE,

FUNCAO INT CHECK(FUNCAO BETWEEN 1 AND 5),

SALARIO FLOAT NOT NULL,

DEPTO INT NOT NULL);

Sobre esta tabela, foi definido um índice primário (codemp – chave primária), e dois índices secundários, um sobre nomeemp, e outro sobre funcao.

Uma pessoa do desenvolvimento reclamou à DBA que algumas de suas consultas sobre essa tabela estavam muito demoradas, e pediu apoio para melhoria do desempenho. A DBA examinou o plano de execução das consultas e, em vez de uma solução sobre o esquema da base de dados, sugeriu a reescrita das consultas.

Qual, dentre as consultas reescritas, melhorou o desempenho da consulta original porque resultou,

no plano de consulta, em uma operação (mais eficiente) sobre um índice?

set transaction isolation level repeatable read; Select max(salario) from funcionarios; Update funcionarios set salario = salario*10 where salario < (select avg(salario) from funcionarios); commit;

Ao definir esse nível de isolamento para sua transação, o programador está sujeito à ocorrência de problemas de acesso concorrente com outras transações. Analise cada assertiva abaixo, assinalando V, se verdadeira, ou F, se falsa.

( ) Leitura suja. ( ) Leitura não repetitiva. ( ) Registro fantasma.

A ordem correta de preenchimento dos parênteses, de cima para baixo, é:

I. Embora a criptografia de chave pública tenha sido usada no passado, hoje ela foi totalmente substituída pela criptografia de chave privada. II. Ataques de canal lateral (em inglês, side-channel attacks ou SCAs) podem obter chaves secretas de criptografia sem usar pesquisa exaustiva e sem conhecer quaisquer detalhes da estrutura da chave. III. Dado um algoritmo de criptografia, quanto maior a chave de criptografia usada, maior a segurança obtida no processo de proteção de dados contra ataques de força bruta.

Quais estão corretas?

Coluna 1 1. Gestão de Capacidade e Desempenho. 2. Gestão de Disponibilidade. 3. Gerenciamento de Implantação. 4. Validação e teste de serviço. 5. Gerenciamento de Continuidade de Serviços.

Coluna 2 ( ) Percentagem de Teste de Aceitação de Serviços não foram aprovadas pelo cliente. ( ) Número de interrupções de serviço. ( ) Tempo de resolução para gargalos de capacidade identificados.

A ordem correta de preenchimento dos parênteses, de cima para baixo, é:

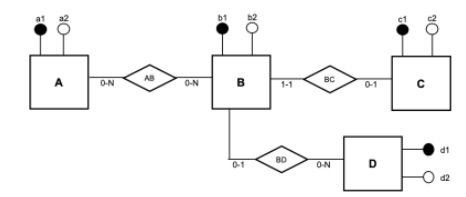

Foi solicitado à projetista que fizesse um modelo lógico relacional correspondente a este DER. A projetista mapeou as entidades A, B, C e D nas tabelas A, B, C e D, respectivamente, cada qual com sua chave primária (atributos a1, b1, c1 e d1, respectivamente) e demais atributos (a2, b2, c2 e d2, respectivamente).

Considere as seguintes assertivas sobre o mapeamento dos relacionamentos:

I. Deve ser criada uma tabela própria para representar o relacionamento AB, na qual deve haver colunas (chaves estrangeiras) referenciando as chaves primárias das tabelas A e B. II. O relacionamento BD pode ser modelado como uma coluna adicional na tabela B (chave estrangeira referenciando a chave primária da tabela D). III. O relacionamento BC pode ser modelado como uma coluna adicional (chave estrangeira) na tabela C ou B, sendo essas escolhas equivalentes. Se incluído na tabela C, esse atributo deve referenciar a chave primária da tabela B, e se incluído na tabela B, deve referenciar a chave primária da tabela C.

Quais estão corretas?

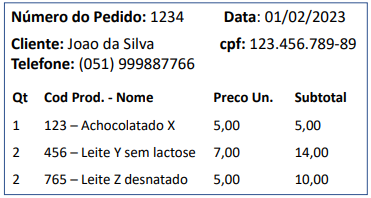

Foi solicitado a um estagiário fazer um projeto conceitual utilizando o modelo EntidadeRelacionamento (ER). Recebeu como recomendação que o projeto deveria conter os dados necessários para gerar este recibo, considerar o emprego correto do modelo de dados ER, e evitar redundâncias de dados que possam levar a problemas de integridade na base de dados.

Utilizando a notação gráfica proposta por Heuser (2009), baseada na proposta por Peter Chen com as extensões mais populares, o estagiário desenhou vários diagramas ER (DER). As caixas representam as entidades, os losangos os relacionamentos, as cardinalidades dos relacionamentos são representadas por pares (min-max), e os “pirulitos” representam os atributos. Quando pintado de preto, um “pirulito” representa uma restrição de identificação.

Qual DER melhor atende às recomendações recebidas?

I. 2PL garante possibilidade de serialização (serializability). II. 2PL evita deadlocks. III. 2PL não permite intercalação de lock e unlock.

Quais estão corretas?

(a) SELECT C.sobrenome, C.renda FROM clientes C WHERE C.codc <> ALL (SELECT V.codc FROM vendas V WHERE V.valor > 1000);

(b) SELECT C.sobrenome, C.renda FROM clientes C WHERE NOT EXISTS (SELECT 1 FROM vendas V WHERE V.valor > 1000 and V.codc = C.codc);

Considere as assertivas abaixo sobre a otimização baseada em desaninhamento de subconsultas no Oracle:

I. O recurso fundamental do desaninhamento de subconsultas é a conversão da subconsulta com processamento relacionado em outra equivalente com processamento não relacionado. II. No caso de uma subconsulta ALL, o desaninhamento explora semi-join. III. No caso de uma subconsulta NOT EXISTS, o desaninhamento explora o anti-join.

Quais estão corretas?

S1: r2(X), r1(X), r2(Y), r1(X), r2(Y), w2(Y) ... S2: r2(X), r2(Y), r1(X), r1(Y), w1(X) ... S3: r2(Y), r2(Y), r1(X), r1(Y), w1(X), w2(X) ...

Quais históricos apresentam operações conflitantes?

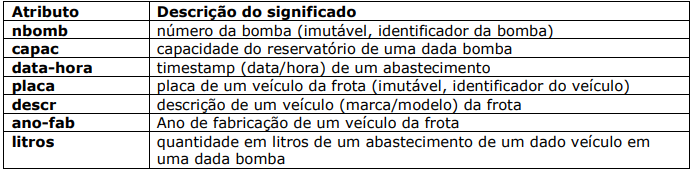

Create table ABASTECIMENTO (nbomb int not null, capac int not null, data_hora timestamp not null, placa char(7) not null, descr varchar(50) not null, ano_fab date not null, litros int not null, primary key (nbomb, data_hora));

A DBA analisou essa proposta e observou que não seguia as formas normais. Com base na descrição dos atributos acima, assinale com V, se a dependência funcional é responsável pelo fato da tabela não estar na terceira forma normal, ou com F, em caso contrário.

( ) nbomb, data-hora → capac ( ) nbomb, data-hora → placa ( ) nbomb, data-hora → ano-fab

A ordem correta de preenchimento dos parênteses, de cima para baixo, é: