Questões de Concurso

Para agente de vigilância sanitária

Foram encontradas 728 questões

Resolva questões gratuitamente!

Junte-se a mais de 4 milhões de concurseiros!

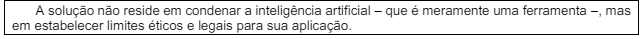

Analise a figura abaixo:

Figura 01

A logomarca da figura 01 refere-se ao navegador

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Analise o período a seguir.

Em relação à pontuação desse período,

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Analise o período a seguir.

As conjunções [1] e [2] em destaque introduzem orações que exprimem

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Considere o trecho a seguir.

Nesse trecho, a presença de verbos

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Considere o trecho a seguir.

As palavras [1], [2] e [3], em destaque, devem ser classificadas, respectivamente, como

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]

Falta ainda ao Brasil uma legislação clara para o uso da inteligência artificial, que leve em conta a atual mudança tecnológica. Apesar de a criação de montagens pornográficas – principalmente envolvendo menores de idade – ser crime, a autoria do produto final está em uma zona cinzenta das leis brasileiras. Para tentar coibir tais abusos, é preciso que existam regulamentações mais rigorosas e mecanismos claros de responsabilização pelo uso da IA para a produção de conteúdo criminoso.

A solução não reside em condenar a inteligência artificial – que é meramente uma ferramenta –, mas em estabelecer limites éticos e legais para sua aplicação. É preciso compreender que o perigo não está na IA em si, mas na ausência de diretrizes éticas. Como toda nova tecnologia, ela demanda técnicas, direitos e deveres totalmente novos, para que seja bem aplicada. Os alertas recentes já são mais do que suficientes para que esse debate se inicie, tanto nas empresas quanto no Congresso.

Disponível em: https://www.em.com.br/ 2023/11/6654195-novos-perigos-da-inteligencia-artificial.html. [Adaptado]