Questões de Concurso

Para investigador de polícia civil

Foram encontradas 1.124 questões

Resolva questões gratuitamente!

Junte-se a mais de 4 milhões de concurseiros!

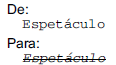

Deseja-se, em um documento editado no Microsoft Office Word (versão 2013 ou 2016, em sua configuração padrão e versão em português), mudar a aparência da palavra “Espetáculo”, da seguinte forma:

Considerando que a palavra “Espetáculo” esteja selecionada,

os botões de formatação de fonte que, se pressionados

em sequência, produzem essa transformação são:

Algoritmos e desigualdade

Virginia Eubanks, professora de ciências políticas de Nova York, é autora de Automating Inequality (Automatizando a Desigualdade), um livro que explora a maneira como os computadores estão mudando a prestação de serviços sociais nos Estados Unidos. Seu foco é o setor de serviços públicos, e não o sistema de saúde privado, mas a mensagem é a mesma: com as instituições dependendo cada vez mais de algoritmos preditivos para tomar decisões, resultados peculiares – e frequentemente injustos – estão sendo produzidos.

Virginia Eubanks afirma que já acreditou na inovação digital. De fato, seu livro tem exemplos de onde ela está funcionando: em Los Angeles, moradores de rua que se beneficiaram dos algoritmos para obter acesso rápido a abrigos. Em alguns lugares, como Allegheny, houve casos em que “dados preditivos” detectaram crianças vulneráveis e as afastaram do perigo.

Mas, para cada exemplo positivo, há exemplos aflitivos de fracassos. Pessoas de uma mesma família de Allegheny foram perseguidas por engano porque um algoritmo as classificou como propensas a praticar abuso infantil. E em Indiana há histórias lastimáveis de famílias que tiveram assistência de saúde negada por causa de computadores com defeito.Alguns desses casos resultaram em mortes.

Alguns especialistas em tecnologia podem alegar que esses são casos extremos, mas um padrão similar é descrito pela matemática Cathy O’Neill em seu livro Weapons of Math Destruction. “Modelos matemáticos mal concebidos agora controlam os mínimos detalhes da economia, da propaganda às prisões”, escreve ela.

Existe alguma solução? Cathy O’Neill e Virginia Eubanks sugerem que uma opção seria exigir que os tecnólogos façam algo parecido com o julgamento de Hipócrates: “em primeiro lugar, fazer o bem”. Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais. Uma terceira ideia seria assegurar que as pessoas que estão criando e rodando programas de computador sejam forçadas a pensar na cultura, em seu sentido mais amplo.

Isso pode parecer óbvio, mas até agora os nerds digitais das universidades pouco contato tiveram com os nerds das ciências sociais – e vice-versa. A computação há muito é percebida como uma zona livre de cultura e isso precisa mudar.

(Gillian Tett. www.valor.com.br. 23.02.2018. Adaptado)

“Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais.”

Essa passagem do quinto parágrafo está corretamente reescrita, segundo a norma-padrão, em:

Algoritmos e desigualdade

Virginia Eubanks, professora de ciências políticas de Nova York, é autora de Automating Inequality (Automatizando a Desigualdade), um livro que explora a maneira como os computadores estão mudando a prestação de serviços sociais nos Estados Unidos. Seu foco é o setor de serviços públicos, e não o sistema de saúde privado, mas a mensagem é a mesma: com as instituições dependendo cada vez mais de algoritmos preditivos para tomar decisões, resultados peculiares – e frequentemente injustos – estão sendo produzidos.

Virginia Eubanks afirma que já acreditou na inovação digital. De fato, seu livro tem exemplos de onde ela está funcionando: em Los Angeles, moradores de rua que se beneficiaram dos algoritmos para obter acesso rápido a abrigos. Em alguns lugares, como Allegheny, houve casos em que “dados preditivos” detectaram crianças vulneráveis e as afastaram do perigo.

Mas, para cada exemplo positivo, há exemplos aflitivos de fracassos. Pessoas de uma mesma família de Allegheny foram perseguidas por engano porque um algoritmo as classificou como propensas a praticar abuso infantil. E em Indiana há histórias lastimáveis de famílias que tiveram assistência de saúde negada por causa de computadores com defeito.Alguns desses casos resultaram em mortes.

Alguns especialistas em tecnologia podem alegar que esses são casos extremos, mas um padrão similar é descrito pela matemática Cathy O’Neill em seu livro Weapons of Math Destruction. “Modelos matemáticos mal concebidos agora controlam os mínimos detalhes da economia, da propaganda às prisões”, escreve ela.

Existe alguma solução? Cathy O’Neill e Virginia Eubanks sugerem que uma opção seria exigir que os tecnólogos façam algo parecido com o julgamento de Hipócrates: “em primeiro lugar, fazer o bem”. Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais. Uma terceira ideia seria assegurar que as pessoas que estão criando e rodando programas de computador sejam forçadas a pensar na cultura, em seu sentido mais amplo.

Isso pode parecer óbvio, mas até agora os nerds digitais das universidades pouco contato tiveram com os nerds das ciências sociais – e vice-versa. A computação há muito é percebida como uma zona livre de cultura e isso precisa mudar.

(Gillian Tett. www.valor.com.br. 23.02.2018. Adaptado)

Algoritmos e desigualdade

Virginia Eubanks, professora de ciências políticas de Nova York, é autora de Automating Inequality (Automatizando a Desigualdade), um livro que explora a maneira como os computadores estão mudando a prestação de serviços sociais nos Estados Unidos. Seu foco é o setor de serviços públicos, e não o sistema de saúde privado, mas a mensagem é a mesma: com as instituições dependendo cada vez mais de algoritmos preditivos para tomar decisões, resultados peculiares – e frequentemente injustos – estão sendo produzidos.

Virginia Eubanks afirma que já acreditou na inovação digital. De fato, seu livro tem exemplos de onde ela está funcionando: em Los Angeles, moradores de rua que se beneficiaram dos algoritmos para obter acesso rápido a abrigos. Em alguns lugares, como Allegheny, houve casos em que “dados preditivos” detectaram crianças vulneráveis e as afastaram do perigo.

Mas, para cada exemplo positivo, há exemplos aflitivos de fracassos. Pessoas de uma mesma família de Allegheny foram perseguidas por engano porque um algoritmo as classificou como propensas a praticar abuso infantil. E em Indiana há histórias lastimáveis de famílias que tiveram assistência de saúde negada por causa de computadores com defeito.Alguns desses casos resultaram em mortes.

Alguns especialistas em tecnologia podem alegar que esses são casos extremos, mas um padrão similar é descrito pela matemática Cathy O’Neill em seu livro Weapons of Math Destruction. “Modelos matemáticos mal concebidos agora controlam os mínimos detalhes da economia, da propaganda às prisões”, escreve ela.

Existe alguma solução? Cathy O’Neill e Virginia Eubanks sugerem que uma opção seria exigir que os tecnólogos façam algo parecido com o julgamento de Hipócrates: “em primeiro lugar, fazer o bem”. Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais. Uma terceira ideia seria assegurar que as pessoas que estão criando e rodando programas de computador sejam forçadas a pensar na cultura, em seu sentido mais amplo.

Isso pode parecer óbvio, mas até agora os nerds digitais das universidades pouco contato tiveram com os nerds das ciências sociais – e vice-versa. A computação há muito é percebida como uma zona livre de cultura e isso precisa mudar.

(Gillian Tett. www.valor.com.br. 23.02.2018. Adaptado)

Algoritmos e desigualdade

Virginia Eubanks, professora de ciências políticas de Nova York, é autora de Automating Inequality (Automatizando a Desigualdade), um livro que explora a maneira como os computadores estão mudando a prestação de serviços sociais nos Estados Unidos. Seu foco é o setor de serviços públicos, e não o sistema de saúde privado, mas a mensagem é a mesma: com as instituições dependendo cada vez mais de algoritmos preditivos para tomar decisões, resultados peculiares – e frequentemente injustos – estão sendo produzidos.

Virginia Eubanks afirma que já acreditou na inovação digital. De fato, seu livro tem exemplos de onde ela está funcionando: em Los Angeles, moradores de rua que se beneficiaram dos algoritmos para obter acesso rápido a abrigos. Em alguns lugares, como Allegheny, houve casos em que “dados preditivos” detectaram crianças vulneráveis e as afastaram do perigo.

Mas, para cada exemplo positivo, há exemplos aflitivos de fracassos. Pessoas de uma mesma família de Allegheny foram perseguidas por engano porque um algoritmo as classificou como propensas a praticar abuso infantil. E em Indiana há histórias lastimáveis de famílias que tiveram assistência de saúde negada por causa de computadores com defeito.Alguns desses casos resultaram em mortes.

Alguns especialistas em tecnologia podem alegar que esses são casos extremos, mas um padrão similar é descrito pela matemática Cathy O’Neill em seu livro Weapons of Math Destruction. “Modelos matemáticos mal concebidos agora controlam os mínimos detalhes da economia, da propaganda às prisões”, escreve ela.

Existe alguma solução? Cathy O’Neill e Virginia Eubanks sugerem que uma opção seria exigir que os tecnólogos façam algo parecido com o julgamento de Hipócrates: “em primeiro lugar, fazer o bem”. Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais. Uma terceira ideia seria assegurar que as pessoas que estão criando e rodando programas de computador sejam forçadas a pensar na cultura, em seu sentido mais amplo.

Isso pode parecer óbvio, mas até agora os nerds digitais das universidades pouco contato tiveram com os nerds das ciências sociais – e vice-versa. A computação há muito é percebida como uma zona livre de cultura e isso precisa mudar.

(Gillian Tett. www.valor.com.br. 23.02.2018. Adaptado)

Algoritmos e desigualdade

Virginia Eubanks, professora de ciências políticas de Nova York, é autora de Automating Inequality (Automatizando a Desigualdade), um livro que explora a maneira como os computadores estão mudando a prestação de serviços sociais nos Estados Unidos. Seu foco é o setor de serviços públicos, e não o sistema de saúde privado, mas a mensagem é a mesma: com as instituições dependendo cada vez mais de algoritmos preditivos para tomar decisões, resultados peculiares – e frequentemente injustos – estão sendo produzidos.

Virginia Eubanks afirma que já acreditou na inovação digital. De fato, seu livro tem exemplos de onde ela está funcionando: em Los Angeles, moradores de rua que se beneficiaram dos algoritmos para obter acesso rápido a abrigos. Em alguns lugares, como Allegheny, houve casos em que “dados preditivos” detectaram crianças vulneráveis e as afastaram do perigo.

Mas, para cada exemplo positivo, há exemplos aflitivos de fracassos. Pessoas de uma mesma família de Allegheny foram perseguidas por engano porque um algoritmo as classificou como propensas a praticar abuso infantil. E em Indiana há histórias lastimáveis de famílias que tiveram assistência de saúde negada por causa de computadores com defeito.Alguns desses casos resultaram em mortes.

Alguns especialistas em tecnologia podem alegar que esses são casos extremos, mas um padrão similar é descrito pela matemática Cathy O’Neill em seu livro Weapons of Math Destruction. “Modelos matemáticos mal concebidos agora controlam os mínimos detalhes da economia, da propaganda às prisões”, escreve ela.

Existe alguma solução? Cathy O’Neill e Virginia Eubanks sugerem que uma opção seria exigir que os tecnólogos façam algo parecido com o julgamento de Hipócrates: “em primeiro lugar, fazer o bem”. Uma segunda ideia – mais custosa – seria forçar as instituições a usar algoritmos para contratar muitos assistentes sociais humanos para complementar as tomadas de decisões digitais. Uma terceira ideia seria assegurar que as pessoas que estão criando e rodando programas de computador sejam forçadas a pensar na cultura, em seu sentido mais amplo.

Isso pode parecer óbvio, mas até agora os nerds digitais das universidades pouco contato tiveram com os nerds das ciências sociais – e vice-versa. A computação há muito é percebida como uma zona livre de cultura e isso precisa mudar.

(Gillian Tett. www.valor.com.br. 23.02.2018. Adaptado)

A pontuação empregada no texto 1A1AAA permaneceria correta se,

I no primeiro parágrafo, o segundo travessão fosse eliminado.

II na linha 1, fosse inserida vírgula logo após “2017”.

III na linha 14, fosse inserida vírgula logo após ‘1997’.

IV na linha 15, a vírgula logo após ‘persistente’ fosse eliminada.

Assinale a opção correta.

Determinada pessoa ocultou a origem de bens provenientes diretamente de infração penal. Provado o crime de ocultação, foi instaurada ação penal contra essa pessoa com fundamento nos dispositivos da Lei n.º 9.613/1998, que dispõe sobre os crimes de lavagem ou ocultação de bens, direitos e valores.

Nessa situação hipotética, conforme a lei nela referida,

Acerca da aplicação da lei processual no tempo e no espaço e em relação às pessoas, julgue os itens a seguir.

I O Brasil adota, no tocante à aplicação da lei processual penal no tempo, o sistema da unidade processual.

II Em caso de normas processuais materiais — mistas ou híbridas —, aplica-se a retroatividade da lei mais benéfica.

III Para o regular processamento judicial de governador de estado ou do Distrito Federal, é necessária a autorização da respectiva casa legislativa — assembleia legislativa ou câmara distrital.

Assinale a opção correta.

Em determinada noite, Pedro arrombou a porta de um centro comercial e subtraiu vários itens de vestuário de oito lojas, de diferentes proprietários.

Nessa situação hipotética, se descoberta a conduta de Pedro, ele deverá responder pelos furtos

Antônio utilizava diariamente o serviço de manobrista de determinado shopping center para estacionar seu carro. Lara, frequentadora do mesmo local, passou a observar a rotina de Antônio e, certa tarde, se apresentou ao manobrista como namorada daquele, informando que havia vindo buscar o carro a pedido do namorado. O manobrista entregou as chaves do carro a Lara, que entrou no veículo e saiu da garagem do estabelecimento em alta velocidade.

A conduta de Lara caracteriza crime de